机器学习:逻辑回归_损失函数

机器学习,逻辑回归,损失函数。逻辑回归的损失函数与线性回归一样,也是求损失的最小值。

损失函数推导过程:

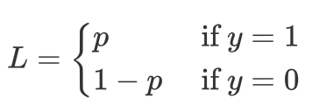

1个样本

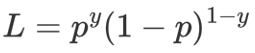

1个样本时,y=1即目标值是1类,sigmoid函数算出的概率是p;y=0即目标值0类,sigmoid函数算出的概率是1-p。公式合并:

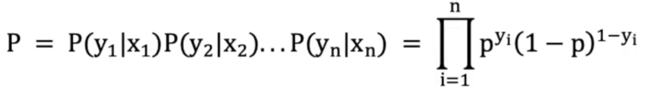

n个样本

n个样本,将1个样本的公式加总。

对数函数

n个样本得到最大似然函数,优化后转为对数函数相加(将连乘变为相加,简化计算过程):

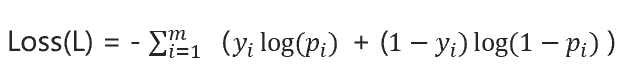

由于损失函数是误差最小值,而逻辑回归最大似然函数是最大值,因此要对函数加负号变为最小值:

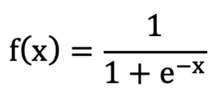

上面公式的p是概率,即sigmoid函数算出的结果:

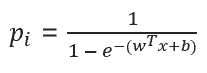

也会写成:

从这里可以看出逻辑回归损失函数与线性回归一样,也通过梯度下降优化损失函数,确定w权重。

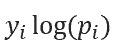

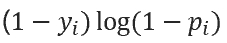

按逻辑回归二分类目标值(1类、0类),损失函数Loss(L)会有两种情况:即结果为1时,y=1,1-y=0,函数取 部分;当结果为0时,y=0,1-y=1,函数取

部分;当结果为0时,y=0,1-y=1,函数取 部分。

部分。